هل الذكاء الاصطناعي يُهدد البشرية | استقالات المسؤولين في OpenAI

هل الذكاء الاصطناعي يُهدد البشرية؟

تسببت إقالة سام ألتمان، الرئيس التنفيذي والمؤسس المشارك لشركة OpenAI، في عام 2023 في حدوث موجة من الجدل حول مستقبل الذكاء الاصطناعي. أثارت الإقالة، التي كانت مدفوعة بمخاوف من سلامة الذكاء الاصطناعي وتأثيره على المجتمع، استقالات جماعية من الموظفين، مما أثار تساؤلات حول ما إذا كانت الشركة قد فقدت بوصلتها.

ما هي شركة OpenAI؟

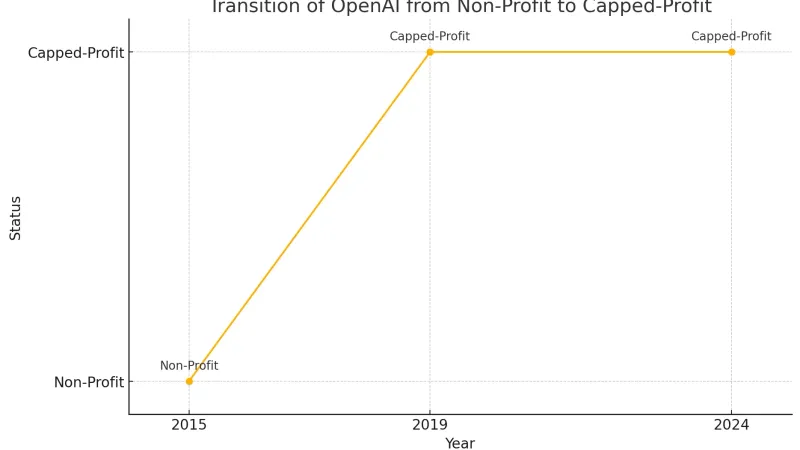

تأسست OpenAI في عام 2015 كمنظمة غير ربحية تركز على تطوير تقنيات الذكاء الاصطناعي الآمنة والمفتوحة. ومع ذلك، في عام 2019، أسست الشركة منظمة ربحية بهدف ضمان التمويل اللازم لتطوير نماذج الذكاء الاصطناعي المتطورة.

دور المحولات في ثورة الذكاء الاصطناعي

في عام 2017، لعبت تقنية تسمى المحولات دورًا رئيسيًا في إثارة ثورة في مجال معالجة اللغات الطبيعية. سمحت المحولات للنماذج اللغوية الكبيرة (LLM)، مثل ChatGPT، بترجمة النص والكلام في الوقت الفعلي تقريبًا.

نموذج LaMDA: هل يمتلك الوعي؟

طور باحثون شركة Google نموذجًا لغويًا كبيرًا متطورًا يسمى LaMDA. أثار LaMDA جدلًا كبيرًا بسبب ادعاءات أحد مطوري Google بأن النموذج أصبح واعيًا. وفي حين نفت جوجل ذلك، إلا أن هذه الحادثة أثارت تساؤلات حول إمكانات وإمكانيات الذكاء الاصطناعي.

ChatGPT: النموذج الذي غير قواعد اللعبة

في عام 2018، أطلقت OpenAI نموذجها التوليدي للغة (LLM) الخاص بها، المعروف باسم GPT-1. بعد عام واحد فقط، تم إطلاق خليفته، ChatGPT، الذي أصبح ظاهرة عالمية.

صراع OpenAI الداخلي

في ظل قيادة ألتمان، تحولت OpenAI من منظمة غير ربحية إلى شركة ربحية. أثار هذا التحول قلق بعض المؤسسين والموظفين، الذين اعتقدوا أن الشركة كانت تضحي بسلامة الذكاء الاصطناعي لصالح تحقيق الأرباح. كان أحد أبرز المعارضين إيليا سوتسكيفر، كبير العلماء ومؤسس مشارك لشركة OpenAI.

استقالات OpenAI

في مايو 2024، أعلن سوتسكيفر استقالته من OpenAI، متبوعًا بقادة آخرين بارزين مثل يان لايكا ودانيال كوكوتاجلو. وأشارت الاستقالات إلى وجود اضطرابات داخلية وتوترات حول اتجاه الشركة.

فريق التوجيه الفائق: حلم لم يتحقق

في يوليو 2023، أسست OpenAI فريق التوجيه الفائق بقيادة سوتسكيفر ولايكا. كان هدفهم الطموح هو تطوير تقنية توجيه ومراقبة أنظمة الذكاء الاصطناعي المتفوقة على الإنسان. ومع ذلك، بعد أقل من عام، تم حل الفريق ولم تتحقق أهدافه.

الذكاء الاصطناعي الخارق: الخطر المحتمل

أشارت OpenAI إلى إمكانية وجود ذكاء اصطناعي خارق (ASI) خلال العقد المقبل. يحذر الخبراء، مثل سوتسكيفر، من أن ASI يمكن أن يشكل تهديدًا للبشرية إذا لم يتم توخي الحذر بشأن سلامته وتماشيه مع القيم الإنسانية.

علاقة OpenAI بـ Microsoft

تعد Microsoft هي المستثمر الرئيسي في OpenAI، وقد أدى تعاونهما إلى الدمج الناجح لتقنيات الذكاء الاصطناعي في منتجات Microsoft. ومع ذلك، أثارت الاضطرابات في OpenAI تساؤلات حول مستقبل الشراكة.

OpenAI: في مفترق طرق

تواجه OpenAI الآن مفترق طرق حرج. أظهرت استقالات المسؤولين والاضطرابات الداخلية ضرورة معالجة مخاوف السلامة والأخلاقيات. إذا تمكنت OpenAI من التغلب على هذه التحديات، يمكنها أن تقود مستقبل الذكاء الاصطناعي إلى مستويات غير مسبوقة. ومع ذلك، إذا فقدت بوصلتها، فإن عواقب ذلك على البشرية يمكن أن تكون وخيمة.

تم نشر هذا المقال بواسطة تطبيق عاجل

التطبيق الأول لمتابعة الأخبار العاجلة في العالم العربي

اضغط لتحميل التطبيق الآن مجاناً

العربية

العربية

الخليج الإماراتية

الخليج الإماراتية

عرب هاردوير

عرب هاردوير

اليوم السابع

اليوم السابع

الاتحاد للأخبار

الاتحاد للأخبار

صحيفة الشرق الأوسط

صحيفة الشرق الأوسط

برق الإمارات

برق الإمارات

الجزيرة نت

الجزيرة نت